会社が Microsoft 365 Copilot を契約してくれた。Outlook の右上には、見たことのないアイコンが出ている。何度か触ってみた。「ふーん」と言って閉じた。それから 1 か月、まだそのままになっていませんか?

私は、いま似たような状況にいる中堅企業の総合職の方を何人も見てきました。共通しているのは「Copilot って結局どう使うんだろう」「ChatGPT のあの派手なデモみたいに動くの?」「触ってみたけど自分の仕事にどう効くか分からない」という戸惑いです。

派手なデモに合わせて期待値を上げると、ほぼ確実に幻滅します。逆に冷静な期待値で臨むと、地味だけれど業務時間が確実に削れる場面が見つかります。差は何かと言えば、地図を持っているかどうかです。

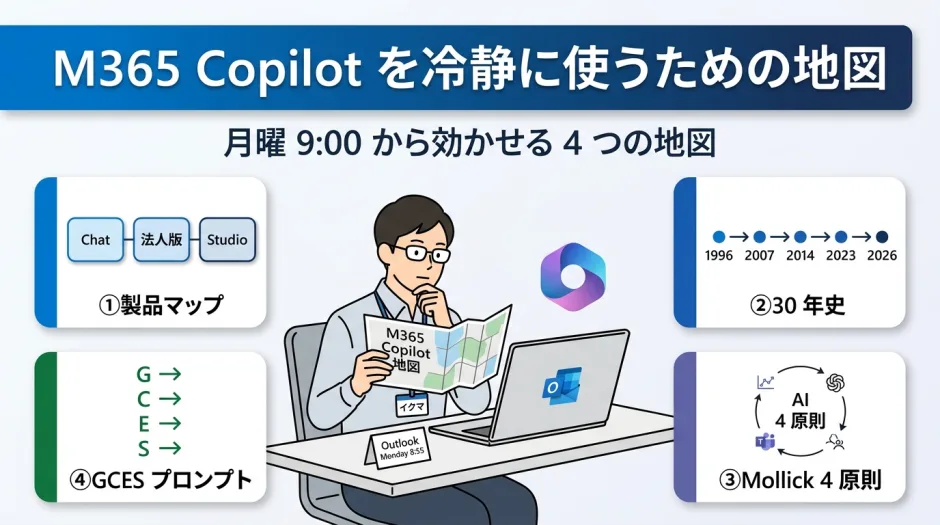

この記事は、月曜 9:00 から自分の業務のどこに Copilot を当てるかを判断できる状態になるための 30 分です。4 つの地図を渡します。

- 365 Copilot の製品マップ

- 30 年近いアシスタントの歴史

- Amara’s Law と Mollick の 4 原則

- GCES プロンプト

の 4 要素です。

ライセンスを持て余す現実

中堅企業の総合職、5 年目前後。Excel は中級、AI はほぼ未経験。会社が Microsoft 365 Copilot を導入したけれど、自分のライセンスで何が動くのか曖昧。隣の席の人は使いこなしているふうに見える。本当のところは誰も実態を知らない。

そんな状況にいる方が、いま日本で何百万人いると考えられます。世界規模で見ても、有料の M365 Copilot を実際に使っている法人ユーザーの割合は、Microsoft の決算資料から推定して 1 割未満という見方が広がっています。米 Microsoft の FY26 Q2 決算をもとに、Yahoo Finance や The Register、Windows Central などの英語メディアが一致して「Microsoft 365 商用顧客に対する有料 M365 Copilot の浸透率は 3.3% 程度」という概算を共有しています。これらは Microsoft 自身が公開した数字ではなく、決算資料からの逆算ですが、桁感としては大きく外れていません。

ここから読み取るべきは「ほとんどの企業はライセンスを持っていない」ではありません。「ライセンスを持っていても、ちゃんと使えている人はそんなに多くない」です。

つまり、いまから地図を持って動き始めれば、社内では十分に早い側に入れます。次の章から地図を 1 つずつ広げていきましょう。

地図1: M365 Copilot の製品マップ

まず押さえておきたいのは、Microsoft の「Copilot」は 1 つではないという事実です。 似た名前のツールが複数同居していて、それが初心者を混乱させる最大の原因です。

公式のアーキテクチャドキュメント How does Microsoft 365 Copilot work? に沿って、業務で関係する 3 種類だけ整理します。

flowchart TD A["Microsoft Copilot 一族(業務で関係する 3 種類)"] A --> B["Microsoft 365 Copilot Chat(無料)<br/>copilot.microsoft.com<br/>個人/職場アカウントで使える Web チャット"] A --> C["Microsoft 365 Copilot(有料・$30/月)<br/>Outlook / Word / Excel /<br/>PowerPoint / Teams 内に統合"] A --> D["Copilot Studio(別売)<br/>業務担当者がローコードで<br/>自社用エージェントを作る"] B --> E["Web 検索ベース<br/>+ サインイン中なら<br/>テナント保護データの一部を参照"] C --> F["Microsoft Graph 経由で<br/>組織内データ参照<br/>(メール・ファイル・カレンダー)"] D --> G["RAG・カスタムスキル<br/>外部システム接続"]

Microsoft 365 Copilot Chat(無料版) は、Web ブラウザで copilot.microsoft.com にアクセスして使うチャット画面です。個人 Microsoft アカウントでも、職場・学校アカウントでもサインインできます。職場アカウントでサインインした場合は、社内データの一部にアクセスできる「保護されたチャット」モードに入ります。最小要件は公式の Microsoft 365 Copilot Chat の要件 にまとまっています。

Microsoft 365 Copilot(有料) は、月額 $30 / ユーザー(日本円換算では月額 4,500 円相当)の有料ライセンスを必要とする本体です。価格と機能の最新情報は Microsoft 365 Copilot の料金(日本) で公開されています。Outlook の中、Word の中、Excel の中、PowerPoint の中、Teams 会議の中、それぞれにアイコンが出てきて、その場で呼び出せます。Microsoft Graph 経由で社内のメール・ファイル・予定・チャット履歴に正規にアクセスして回答が出てくる仕組みになっていて、これが無料版の Chat と決定的に違うポイントです。

Copilot Studio は、業務担当者が自分たちの業務に合わせた Copilot エージェントをローコードで作る開発ツールです。情シスや業務部門のリーダーが触る領域なので、初心者の最初の地図には載せません。「そういう別売のツールがある」と頭の隅に置くだけで充分です。

自分が持っているライセンスはどれかを確認することが、最初の一歩です。 管理者に「私のアカウントで M365 Copilot のどのライセンスが付いていますか」と一言聞くか、Outlook を開いて Copilot アイコンが出るかどうかを確認してください。アイコンが出れば有料版、出ないけれど職場アカウントで copilot.microsoft.com に入れれば無料版(保護モード)です。

地図2: 30 年近いアシスタントの歴史

Microsoft はアシスタント機能を 30 年近く出しては消してきました。 Copilot もこの系譜の中にあります。「ある日突然出てきた魔法」ではありません。

timeline title Microsoft アシスタントの歴史 1996/11 : Office 97 リリース<br/>Clippit(Clippy)デビュー<br/>日本語版は「カイル」(イルカ) 2007 : Office 2007<br/>Office アシスタント機能<br/>完全廃止 2014/04 : Cortana 発表<br/>Windows Phone 8.1 の<br/>音声アシスタント 2023/03/16 : Microsoft 365 Copilot 発表<br/>Jared Spataro<br/>「副操縦士」コンセプト 2023年後半 : Cortana サポート終了<br/>Windows での<br/>スタンドアロンアプリ廃止 2026/04 : Copilot Keyboard で<br/>カイル復活<br/>Copilot 対応キャラの一種

最初は Clippit(クリッピー) でした。1996 年 11 月 19 日に Microsoft が Office 97 を製造工程に向けて発表したアーカイブが Microsoft の 1996 年プレスリリース として残っています。Clippit はこの Office 97 の標準アシスタントとして登場しました。日本語版を含む東アジア諸言語版では、イルカの 「カイル」 が標準キャラクターになります(出典: Wikipedia(ja) Office アシスタント — コミュニティの整理として)。

「カイル」は 2000 年代に「お前を消す方法」というインターネットミームを生み、日本のオフィスワーカーの脳内に変な形で定着します。

そして Office 2007 で Office アシスタント機能は完全に廃止されます。役に立たないのに毎回出てきて操作を遮るユーザー体験への評価は、社内外でも厳しいものでした。Microsoft がこの系列を一度終わらせたのは、いまから振り返れば賢明な判断でした。

次の登場は 2014 年 4 月です。Cortana が Windows Phone 8.1 の新機能としてデビューしました(出典: ITmedia「Microsoft、『Cortana』発表」)。名前は『Halo』に登場する女性 AI キャラクターから取られていて、Apple の Siri 対抗の音声アシスタントとして売り出されました。

しかし Cortana も長くは続きませんでした。2023 年 6 月、ITmedia は「さようなら Cortana — Copilot 登場で Microsoft がサポート終了へ」を報じます。2023 年後半以降、Windows でのスタンドアロンアプリとしての Cortana サポートは打ち切られました。

そして 2023 年 3 月 16 日、Microsoft 365 Copilot が発表されます。当時 CMO だった Jared Spataro による Introducing Microsoft 365 Copilot — your copilot for work という公式ブログ投稿が一次情報です。翌 3 月 17 日、News Center Japan が日本語版「Microsoft 365 Copilot を発表 — 仕事の副操縦士」を出しました。「副操縦士」というのは Copilot を直訳した日本語タイトルです。

最近のサプライズは 2026 年 4 月、新しい Copilot Keyboard 上で、Copilot 対応キャラクターの一種として カイルが復活した ことです(コミュニティ報道として: PC Watch「カイルくんが Copilot Keyboard で華麗に復活したので『お前を消す方法』を聞いてみた」)。世代を超えて記憶された AI キャラクターが Copilot の入り口に戻ってきたわけで、Microsoft 自身もこの 30 年近い系譜を意識しているのでしょう。

ここから読み取るべきは、Microsoft はアシスタントを何度も試して何度も失敗してきたという事実です。 過去 3 回の系譜(Clippit / Cortana → 廃止)に対して、Copilot が決定的に違うのは中身が大規模言語モデル(LLM)になっている点だけです。インターフェースの工夫だけで定着させようとした過去とは段階が違います。

地図3: Amara’s Law と Mollick の 4 原則

新しい技術に対する人間の評価は、短期では過大、長期では過小に振れる傾向があります。 これは未来学者 Roy Amara が提唱した経験則で、Mollick は『Co-Intelligence』Chapter 6「AI as a Coworker」でこの法則を AI に重ねて引用しています。

“We tend to overestimate the effect of a technology in the short run and underestimate the effect in the long run.”

「私たちは短期的にはテクノロジーの効果を過大評価し、長期的にはその効果を過小評価する傾向があります。」

flowchart LR A["Amara's Law<br/>短期過大評価/長期過小評価"] A --> B["短期過大評価ゾーン<br/>「Copilot で全部できる」<br/>↓<br/>幻滅"] A --> C["冷静ゾーン<br/>「いま何ができて<br/>何ができないか」を<br/>地図で持つ"] A --> D["長期過小評価ゾーン<br/>「Copilot なんて大したことない」<br/>↓<br/>5 年後に静かに業務が変わる"]

Copilot に当てはめると、短期過大評価ゾーンの人は「Copilot に投げれば何でも返ってくる」と思い込み、ハルシネーション混じりの返答に幻滅して使うのをやめます。長期過小評価ゾーンの人は「派手なデモを見ても自分の仕事には関係ない」と決めつけて、5 年後に隣の同僚と業務スピードで明確に差が付いていることに気付きます。

冷静ゾーンに留まるための実践フレームを、Wharton スクール准教授の Ethan Mollick が著書『Co-Intelligence: Living and Working with AI』(Portfolio/Penguin、2024)の Chapter 3「Four Rules for Co-Intelligence」で 4 原則にまとめています。Mollick は AI の業務利用に関する学術研究を多数発表していて、原則自体は彼の検証から出てきたものです。学術ベースの整理として引用します。

mindmap root((Mollick<br/>4 原則)) Always invite AI to the table まず誘ってみる 自分の業務に AI を最初から持ち込む Be the human in the loop 全部任せない 最終チェックは人間 Treat AI like a person but tell what kind 役割・専門・トーンを指示する ペルソナ設定が一番強調される Assume this is the worst AI これが最悪だと思って使う 半年後にはもっと良くなる

Always invite AI to the table(まず誘う) は、AI を「最後に余裕があれば使う」のではなく「最初から呼ぶ」習慣です。月曜の朝、Outlook を開いた瞬間に「このメールを Copilot に投げてみよう」と一回試すこと。試して使えなければ自分でやればよいだけで、試さない選択肢は捨てます。

Be the human in the loop(人間がループに入る) は、AI 任せにしないことです。Copilot が出してきた議事録ドラフトを「とりあえずそのまま送信」した瞬間に、ハルシネーションが事故になります。最終確認は人間の責任。AI は下書きまで。

Treat AI like a person, but tell it what kind of person it is(人として扱うが、どんな人かを伝える) は、Mollick が 4 原則の中で一番強調する点です。原典のサブタイトルにある “but tell it what kind of person it is”(「でも、それがどんな人なのか教えてよ」) の部分が肝です。

ただ人として扱うだけでなく、どんな役割・専門・トーンの人かをペルソナとして指示することがセットになります。新人に仕事を頼むとき、人は無意識に「経理部 5 年目で内部統制に詳しい人」のように背景・専門・口調を伝えます。Copilot にも同じことをします。後で出てくる GCES の 4 要素のうち Context(誰宛・どの状況)はこの原則を具体化したものです。

Assume this is the worst AI you’ll ever use(これが最悪だと思って使う) は、現在の Copilot ができないことに固執しないことです。半年後・1 年後にはもっとよくなります。今できないことは記録しておいて再挑戦する。今できることだけは確実に取りに行く。

この 4 原則を覚えるだけで、月曜から金曜までの 5 日間、毎日違う原則を試すフレームができます。

地図4: GCES プロンプトの 4 要素

ChatGPT 感覚で「メールまとめて」とだけ書くと、Copilot は使い物にならない返答を返します。 業務で再現性を出すには、プロンプトに最低限 4 つの要素を埋める必要があります。これを GCES と呼びます。

出典は Microsoft 公認の Copilot 専門家 Lisa Crosbie が Microsoft Press から出している『Microsoft Copilot Pro Step by Step』(Microsoft Press, 2025) Chapter 2「Use the elements of effective prompts」セクションで、原典は Goal / Context / Source / Expectations の順に章立てされています。本記事では覚えやすさのため GCES(Goal / Context / Expectations / Source)の順に並べ替えていますが、4 要素自体は原典と同一です。

flowchart TD G["G: Goal<br/>何のために、何が欲しいか"] C["C: Context<br/>誰宛・どの状況・<br/>どの参照ファイル"] E["E: Expectations<br/>形式・長さ・トーン"] S["S: Source<br/>何を根拠にするか"] G --> C --> E --> S --> O["Copilot 出力"]

実際のプロンプトに当てはめてみます。月曜の朝、経理部の山田さんから来た見積書確認のメールに返信したい状況です。

弱いプロンプト(GCES が抜けている例):

このメールに返信して

これだと Copilot は背景もトーンも分からないので、定型文を返してきます。中身が空疎だったり、こちらが本当は伝えたいニュアンスが抜けたりします。

強いプロンプト(GCES が埋まっている例):

このスレッドに対して、30 分後の社内会議に間に合わせる返信ドラフトを作ってください。 (Goal) 相手は経理部の山田さんで、添付の見積書 v3 を確認してくれた前提です。 私は営業部のイクマで、今期の予算枠が少しタイトな状況を共有済みです。 (Context) 箇条書き 5 行以内、丁寧語、200 字以内でお願いします。 冒頭に「お忙しいところ確認ありがとうございます」を入れてください。 (Expectations) このスレッドの直近 5 通と、添付の見積書 v3、先週の Teams 会議の議事録を根拠にしてください。 私のメモには根拠を求めないでください。 (Source)

4 要素のうち 1 つでも抜けると、Copilot は欠けた部分を勝手に埋め始めます。 これがハルシネーションの主要な原因の 1 つです。GCES を埋めるのは面倒に見えますが、業務で繰り返すうちに 30 秒で書ける定型になります。机の見える場所に「G / C / E / S」と縦書きでメモを貼っておくのがおすすめです。

地味な罠を 4 つ自己診断する

罠1: ChatGPT 感覚でプロンプトを書いている

「メールまとめて」「議事録作って」だけで投げて、結果に幻滅していませんか? GCES の 4 要素が 1 つでも抜けていないか確認してください。

罠2: 個人 Microsoft アカウントに業務データを投げている

copilot.microsoft.com に個人アカウントでサインインしている状態で、社内見積書のスクリーンショットを貼って要約させると、個人アカウントの利用規約と社内データの取扱いポリシーが衝突します。公式の Data, Privacy, and Security は、法人版で保護される範囲を明示していますが、個人版は別契約です。

業務データは法人アカウント(職場・学校アカウント)でサインインしている Copilot にしか入れない。これだけ守ってください。アカウントの種類を理解する補助には、コミュニティの整理として aiv.co.jp「Copilot のアカウントの種類」 が読みやすいです。

罠3: 動く前提条件を見落としている

ライセンスを持っていても、Copilot が動くための前提条件を 1 つでも満たしていないと「アイコンが出ない」「使ってもエラーが出る」が発生します。公式の Microsoft 365 Copilot Chat の要件 にまとまっている主な前提を、月曜の朝にチェックリストで確認しておきましょう。

- [ ] 自分のサインイン中アカウントが、職場・学校アカウントである

- [ ] 組織で SharePoint Online / OneDrive for Business / Exchange Online / Teams のいずれかが有効になっている

- [ ] Outlook / Word / Excel など各アプリが対応バージョンに更新されている

- [ ] テナント側で Copilot のライセンスが自分に割り当て済み

このうち最後の項目は管理者側の設定なので、自分で確認できないときは情シスに「私のアカウントに M365 Copilot のライセンスが付いていますか」と一言聞いてください。

罠4: Just Me(自分だけでやる)に逃げ続けている

Mollick の 4 原則の最初、Always invite AI to the table を飛ばし続けている状態です。「自分でやった方が早い」と思っているうちに、隣の席で AI に振り続ける同僚と 1 年で大きな差が付きます。短期過大評価ゾーンを警戒するあまり長期過小評価ゾーンに落ちると、5 年後に取り返しがつきません。

最初の invite は失敗してもいいので試すこと。失敗の理由を 1 行メモするだけで、次の試行のヒントになります。

TL;DR

- M365 Copilot は 1 つではなく 3 種類(Chat 無料/法人版/Copilot Studio)。自分のサインイン中アカウントを確認して、どのライセンスを持っているかを把握する

- Microsoft はアシスタントを 30 年近く出しては消してきた(1996 Clippy → 2007 廃止 → 2014 Cortana → 2023 Copilot → 2026 カイル復活)。Copilot もこの系譜だが、中身が LLM になった点だけ過去と決定的に違う

- Amara’s Law(短期過大評価/長期過小評価)の罠を避けるため、Mollick の 4 原則(invite / human in loop / treat as person / assume worst)で冷静に使う

- プロンプトは GCES の 4 要素(Goal・Context・Expectations・Source)を 1 文ずつ埋める。1 つでも抜けるとハルシネーションの原因になる

- 動く前提条件(職場アカウント/SharePoint・Exchange Online/対応バージョン/ライセンス割り当て)を月曜朝にチェックリストで確認する

パイソンエンジニア部

パイソンエンジニア部